A ferramenta de vídeo Sora 2 da OpenAI proibiu o uso de semelhanças humanas reais e personagens protegidos por direitos autorais em vídeos gerados por IA após aumentar a reação de celebridades, criadores e detentores de direitos.

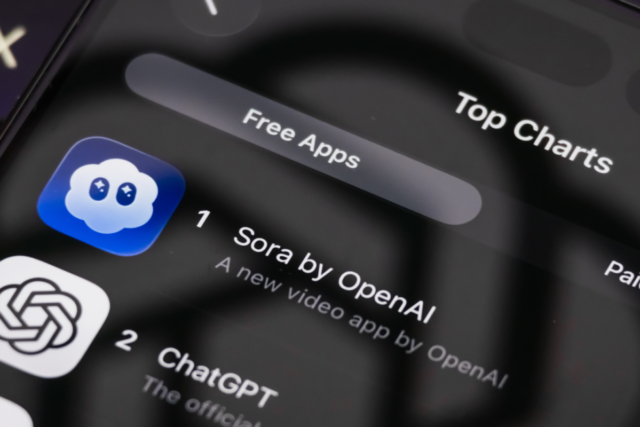

Sora, que a OpenAI lançou publicamente em dezembro de 2024, pode gerar vídeos altamente realistas em apenas alguns segundos após inserir um prompt de texto ou imagem.

Os vídeos criados com a plataforma ganharam atenção viral por seu realismo peculiar, com clipes de tudo, desde Mickey Mouse andando de skate até Jake Paul vestido como Tinkerbell.

Mas quando os usuários do Sora 2 começaram a recriar celebridades sem consentimento, a OpenAI foi forçada a agir.

De acordo com a política atualizada da empresa, qualquer pessoa ou personagem deve aceitar antes de usar sua imagem.

Na segunda-feira, o ator Bryan Cranston emitiu um comunicado por meio do Screen Actors Guild-American Federation of Television and Radio Artists (SAG-AFTRA), elogiando publicamente a OpenAI por endurecer as regras após reclamações de atores cujos rostos e vozes apareceram em clipes de IA sem permissão.

“Fiquei profundamente preocupado não só comigo, mas com todos os artistas cujo trabalho e identidade poderiam ser mal utilizados desta forma”, disse Cranston. “Sou grato pelos princípios da OpenAI e pela elevação de sua barreira.”

Os vídeos gerados por IA estão se tornando cada vez mais comuns na Internet, fazendo muitas pessoas questionarem se o que veem é confiável. Desde imagens de coelhinhos pulando em trampolins até bebês nascendo e andando, alguns vídeos são fáceis de assistir, enquanto outros podem enganar os espectadores.

Vasant Dhar, professor da Stern School of Business da Universidade de Nova York e autor do próximo livro Pensando com máquinas: o admirável mundo novo da IA (Wiley, lançado em 18 de novembro), disse Semana de notícias Usar analogias de pessoas em conteúdo de IA “não é óbvio” para justificar.

“Não está claro para mim se isso é uso justo”, disse Dhar Semana de notícias. “Há muita ambigüidade em torno disso – depende de como será usado. É difícil escolher uma política que diga ‘isso pode realmente funcionar para beneficiar a humanidade, então vamos mantê-lo aberto’, embora saibamos que há todos os tipos de danos potenciais associados a isso.”

A lacuna da celebridade morta

No entanto, o novo guardrail não abrange todos. Os usuários ainda criam conteúdo com pessoas mortas como Robin Williams, Michael Jackson e Elvis Presley.

A família de Martin Luther King Jr. pressionou com sucesso o Sora 2 em 17 de outubro para bloquear sua imagem, mas outras propriedades não tiveram a mesma sorte. A filha de Williams, Zelda Williams, recentemente pediu aos usuários que “parassem de enviar vídeos de IA para o papai”.

“Está tudo bem se você tiver um patrimônio e os meios e tiver pessoas que se preocupam com sua memória e seu legado e podem dizer: ‘Estou optando por não participar’.

Outros clipes de celebridades mortas incluem imagens de Tupac Shakur com Marilyn Monroe e a falecida Rainha Elizabeth II roubando um supermercado.

A chamada “brecha das celebridades falecidas” expõe uma área legal cinzenta: os direitos de imagem póstuma variam amplamente em todo o mundo, dando às famílias poucos recursos.

Na sexta-feira, a OpenAI disse em um comunicado: “Embora haja um forte interesse pela liberdade de expressão na representação de figuras históricas, a OpenAI acredita que as figuras públicas e suas famílias deveriam, em última análise, ter controle sobre como suas imagens são usadas. Representantes autorizados ou proprietários de propriedades podem solicitar que suas imagens não sejam usadas em participações especiais de Sora.”

Por exemplo, a capacidade do património para as pessoas optarem por não participar não é suficientemente boa na maioria dos casos.

“Na verdade, ainda é muito para pessoas que não possuem propriedades, que não têm capacidade de se defender, cujas projeções futuras podem ser alteradas pela IA, de maneiras que não são apreciáveis”, disse ele. “Eles podem pegar alguém que era um santo e transformá-lo em um demônio. Isso é justo? Acho que é um caminho muito escorregadio.”